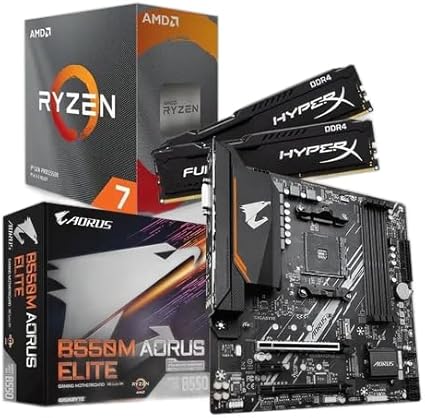

KIT UPGRADE AMD RYZEN 7 5700X, MB B550M AORUS ELITE, 16GB 3200MHZ RAM

O GLM-4.5, nova geração da série General Language Model, foi apresentado pela equipe do OpenBMB, ligada à Beijing Academy of Artificial Intelligence. O modelo open-source surge como evolução direta do GLM-4 e promete desempenho equiparável a sistemas proprietários como GPT-4 e Claude 3, mas com a vantagem da transparência de código e liberdade de implantação local.

Arquitetura Mixture-of-Experts reduz custo computacional

A principal novidade técnica do GLM-4.5 é a adoção da arquitetura Mixture-of-Experts (MoE). Nesse arranjo, apenas os “experts” necessários são ativados em cada inferência, diminuindo o volume de parâmetros usados simultaneamente e, em consequência, o consumo de memória e energia. Segundo especialistas em infraestrutura de IA, a abordagem permite executar o modelo em servidores convencionais — ou mesmo em nuvens privadas — com menor investimento em GPU, sem sacrificar a precisão das respostas.

Relatórios indicam que a eficiência obtida com a MoE facilita escalar a solução em ambientes distribuídos. Para empresas que desejam controlar custos operacionais ou operar em setores regulados, a possibilidade de rodar o modelo dentro do próprio data center elimina dependência de APIs comerciais e reduz riscos de vazamento de dados.

Capacidades multimodais e suporte a múltiplos idiomas

O GLM-4.5 é classificado como multimodal: além de texto, o modelo aceita imagens, PDFs e outros documentos estruturados como entrada, gerando saídas compatíveis em uma única arquitetura. A funcionalidade atende a demandas de setores como logística, automação jurídica e diagnóstico médico, onde é comum lidar com informações híbridas.

Nos testes divulgados pelos desenvolvedores, o sistema manteve alto desempenho em tarefas multilingues, incluindo avaliação em português, espanhol e mandarim. O suporte a linguagens de programação (Python, Java, SQL, entre outras) reforça o uso em pipelines de engenharia de dados, geração de scripts e automações corporativas.

Versão AIR leva IA generativa ao edge

Em paralelo à edição principal, o consórcio OpenBMB anunciou o GLM-4.5 AIR, variante otimizada para ambientes com recursos limitados. Ajustes de quantização e refinamentos na arquitetura permitem operar com baixa latência em dispositivos embarcados, sensores industriais e sistemas offline, cenário típico de aplicações de edge computing.

De acordo com dados oficiais, a versão AIR mantém grande parte da qualidade do modelo completo, mas consome menos memória e energia. Isso viabiliza casos de uso em robôs autônomos, redes hospitalares sem conexão constante ou equipamentos instalados em áreas remotas.

Abertura de código impulsiona personalização e compliance

Diferentemente de sistemas fechados, o GLM-4.5 disponibiliza pesos e código-fonte completos. Equipes de TI podem auditar o conteúdo, remover viéses indesejados e adaptar respostas para requisitos locais, fator valorizado por setores regulados como financeiro, saúde e administração pública. “O acesso irrestrito ao modelo garante soberania tecnológica e favorece adequação a normas de privacidade”, avaliam consultores de segurança da informação.

Ferramentas populares, como Hugging Face Transformers e LangChain, já oferecem integração nativa, possibilitando prototipagem rápida e ajuste fino com técnicas como LoRA ou QLoRA. Para startups, essa compatibilidade reduz tempo até o MVP e facilita evolução do projeto sem contratos vinculantes de longo prazo.

Casos de uso emergentes apontam potencial corporativo

Empresas de business intelligence têm explorado o GLM-4.5 para resumir grandes volumes de texto e extrair insights estruturados. Em engenharia de prompts, a flexibilidade multilingue acelera a geração de relatórios técnicos sob demanda. Na área de cibersegurança, especialistas utilizam o modelo para simular ataques e detectar padrões anômalos em interações de chatbot, fazendo ajustes preventivos contra alucinações.

Imagem: Internet

Outra aplicação em expansão envolve sistemas retrieval-augmented generation (RAG). Nessa abordagem, o modelo consulta bases externas para enriquecer o contexto antes de produzir respostas, aumentando precisão e confiabilidade. De acordo com desenvolvedores, a combinação entre RAG e GLM-4.5 tem sido adotada em projetos internos de ESG, atendimento ao cliente e análise jurídica.

Impacto para o usuário e para o mercado de IA

Para organizações que buscam reduzir dependência de fornecedores globais e controlar dados sensíveis, o GLM-4.5 representa alternativa sólida. Ao permitir implantação local, o modelo diminui custos variáveis por token e oferece previsibilidade orçamentária. Usuários finais podem perceber respostas mais rápidas, principalmente em cenários offline ou com largura de banda restrita.

Já para o ecossistema open-source, a chegada de um sistema de porte comparável ao GPT-4 reforça a tendência de democratização da IA avançada. Especialistas avaliam que a concorrência deve acelerar a criação de ferramentas complementares, impulsionando inovação em segmentos como assistência médica, manufatura e educação.

Se você acompanha a evolução dos grandes modelos de linguagem, vale observar como o GLM-4.5 pode remodelar estratégias de adoção de IA, influenciar custos de operação e ampliar o leque de serviços baseados em inteligência artificial.

Para continuar por dentro de outras novidades em inteligência artificial, confira as últimas matérias na seção dedicada em Remanso Notícias – IA.

Curiosidade

Você sabia que a fundação do OpenBMB nasceu de um esforço colaborativo entre universidades e empresas de Pequim para acelerar pesquisa em IA de código aberto? A iniciativa busca equilibrar o domínio de grandes provedores ocidentais, oferecendo modelos de alto desempenho que qualquer pessoa pode inspecionar e adaptar. O GLM-4.5 é o primeiro da linha a contar com uma variante otimizada para hardware de borda, refletindo a corrida global por soluções que funcionem mesmo fora da nuvem.

Para mais informações e atualizações sobre tecnologia e ciência, consulte também:

Quando você efetua suas compras por meio dos links disponíveis aqui no RN Tecnologia, podemos receber uma comissão de afiliado, sem que isso acarrete nenhum custo adicional para você!